- Автоматизация

- Антропология

- Археология

- Архитектура

- Биология

- Ботаника

- Бухгалтерия

- Военная наука

- Генетика

- География

- Геология

- Демография

- Деревообработка

- Журналистика

- Зоология

- Изобретательство

- Информатика

- Искусство

- История

- Кинематография

- Компьютеризация

- Косметика

- Кулинария

- Культура

- Лексикология

- Лингвистика

- Литература

- Логика

- Маркетинг

- Математика

- Материаловедение

- Медицина

- Менеджмент

- Металлургия

- Метрология

- Механика

- Музыка

- Науковедение

- Образование

- Охрана Труда

- Педагогика

- Полиграфия

- Политология

- Право

- Предпринимательство

- Приборостроение

- Программирование

- Производство

- Промышленность

- Психология

- Радиосвязь

- Религия

- Риторика

- Социология

- Спорт

- Стандартизация

- Статистика

- Строительство

- Технологии

- Торговля

- Транспорт

- Фармакология

- Физика

- Физиология

- Философия

- Финансы

- Химия

- Хозяйство

- Черчение

- Экология

- Экономика

- Электроника

- Электротехника

- Энергетика

Информационные сети и телекоммуникации.

Информационные сети и телекоммуникации.

Конспект лекций

Лекция 1

Лекция 1. Основные понятия и определения. Понятие информации. Системы передачи информации. Измерение количества информации

Развитие человеческой цивилизации это непрерывное и динамичное развитие средств общения от личного до общественного, от примитивных с помощью жестов, мимики, звуков и света, и оптических семафоров до создания глобальных телекоммуникационных систем и сетей, обеспечивающих передачу, прием, обработку, распределение и хранение различной информации.

Под информацией понимается совокупность сведений о событиях, явлениях, процессах, понятиях и фактах, предметах и лицах независимо от формы представления.

Телекоммуникационные системы - это комплекс технических средств, обеспечивающих электрическую связь (электросвязь) определенного типа.

Вприведенном определении есть ключевые слова «связь» и «электросвязь». Что же это такое?

Связь (communication) - обмен информацией или пересылка информации с помощью средств, функционирующих в соответствии с согласованными правилами (называемыми в конкретных условиях протоколами).

Международная конвенция по электросвязи определила «электросвязь» (Найроби, 1982 год) как «...передачу, получение и прием знаков, сигналов, письменного текста, изображения и звуков или сообщений любого рода по проводной, радио и оптической или другим электромагнитным системам...».

В «Основных положениях развития ВСС РФ» электросвязи дается такое определение: электросвязь (telecommunication) - передача или прием знаков, сигналов, текстов, изображений, звуков по проводной, оптической или другим электромагнитным системам. Это определение может быть выражено в такой форме: электросвязь - это передача и прием сообщений с помощью сигналов электросвязи по проводной, радио, оптической или другим средам распространения.

Вышеприведенные определения содержат знаковые слова: сообщение, сигнал, сигнал электросвязи.

Сообщение - форма представления информации для передачи ее от источника информации к потребителю. Применительно к сфере телекоммуникаций сообщение - это информация, передаваемая с помощью электромагнитных сигналов средствами электросвязи. Примеры сообщений: текст телеграммы, речь, музыка, фототелеграмма-факс, телевизионное изображение, данные с выхода вычислительных машин, команды в системах телеуправления и телеконтроля и др.

Сигнал - материальный носитель или физический процесс, отражающий (несущий) передаваемое сообщение. Таким образом, сигнал –это изменяющаяся определенным образом физическая величина. В телекоммуникационных системах и сетях используются электрические, оптические, электромагнитные и другие виды сигналов.

Классификация сигналов может быть самой разнообразной, но особый интерес представляют электрические сигналы, называемые сигналами электросвязи и представляющие электрические напряжения или токи, изменение параметров которых во времени отражает передаваемое сообщение.

К электрическим сигналам относятся: телефонные, телеграфные, факсимильные сигналы, сигналы передачи данных, сигналы телевизионного и звукового вещания, сигналы телеконтроля и телеуправления.

С понятием телекоммуникационные системы тесно связано понятие телекоммуникационные сети, представляющие совокупность пунктов, узлов и линий (каналов, трактов) их соединяющих.

Телекоммуникационные системы и телекоммуникационные сети, взаимодействуя друг с другом, образуют систему электросвязи - комплекс технических средств, обеспечивающих электросвязь определенного вида.

Классификация систем электросвязи весьма разнообразна, но в основном определяется видами передаваемых сообщений, средой распространения электрических сигналов (рис. 1) и способами распределения информации: коммутируемые или некоммутируемые сети передачи сообщений.

Телекоммуникационные системы и сети представляют совокупность технических средств, осуществляющих следующие операции при передаче сообщения от источника к получателю:

- преобразование сообщения, поступающего от источника сообщения (ИС) в сигнал электросвязи;

- преобразование сигналов электросвязи в форму, удобную для передачи и получателя сообщения (ПС);

- сопряжение сигналов электросвязи с каналами передачи и станциями коммутации (СК), установленных в оконечных пунктах (ОП) или узлах связи (УС).

Рис. 1. Классификация систем электросвязи по видам передаваемых сообщений и среды распространения

Обобщенная структурная схема взаимодействия телекоммуникационных систем и сетей представлена на рис. 2, где приняты следующие обозначения:

ИС - источник сообщения (информации); ПР1 - преобразователь сообщения в электрический сигнал, называемый первичным электрическим сигналом (в дальнейшем просто «первичный сигнал»); СК - станция коммутации, представляющая совокупность коммутационной и управляющей аппаратуры, обеспечивающей установление различного вида соединений (местные, междугородные, международные, входящие, исходящие и транзитные) и реализующей определенный метод коммутации (коммутация каналов, коммутация сообщений или коммутация пакетов); ОС1 - оборудование сопряжения, осуществляющее преобразование первичных сигналов в линейные электрические сигналы, физические характеристики которых согласуются с параметрами передачи среды распространения - СР; ОС-1 - оборудование сопряжения, осуществляющее преобразование линейных электрических сигналов в исходные первичные сигналы; ПР-1 - преобразователь первичного сигнала в сообщение; ПС - получатель сообщения.

Рис. 2. Взаимодействие телекоммуникационных систем и сетей

Комплекс технических средств и среды распространения, обеспечивающий передачу первичного сигнала в определенной полосе частот или с определенной скоростью передачи между сетевыми станциями или сетевыми узлами, называется каналом передачи.

Для обмена информацией телекоммуникационные системы используют естественную и искусственную среду. Телекоммуникационные системы вместе со средой для передачи данных образуют телекоммуникационные сети. Примеры телекоммуникационных сетей:

– почтовая связь;

– телефонная связь общего пользования (ТФОП);

– мобильные телефонные сети;

– телеграфная связь;

– интернет – глобальная сеть взаимодействия компьютерных сетей;

– сеть проводного радиовещания;

– сеть кабельного радиовещания;

– сеть телевизионного и радиовещания;

– ведомственные сети органов государственной службы, системы управления воздушными, морскими, космическими судами;

– энергетические системы;

– глобальные сети спасения и безопастности (Инмарсат, ГМССБ, Глонасс).

Перечисленные выше телекоммуникационные системы, как правило, тесно взаимодействуют друг с другом и используют общие ресурсы для реализации связи. Для организации такого взаимодействия в каждом государстве и в мире, в целом, действуют специальные органы, которые регулируют порядок использования общих ресурсов, определяют общие правила взаимодействия (протоколы) телекоммуникационных систем и разрабатывают перспективные телекоммуникационные технологии. Для реализации связи на расстоянии телекоммуникационные системы используют:

– системы коммутации;

– системы передачи данных;

– системы доступа и управления каналами передачи;

– системы преобразования информации.

Цель создания телекоммуникационных систем – это передача информации. Известно несколько определений информации, например, информация – это отображение разнообразия, которое существует во Вселенной, или информация – это сведения, являющиеся объектом хранения, передачи и преобразования. Для целей передачи, преобразования и приема информации будем использовать второе определение. Для передачи информации используют сигнал, который является физической величиной и с его параметрами так или иначе связана информация.

Областей применения теории информации очень много – это кибернетика, математика, бионика, экономика, телемеханика, социология, связь, криминалистика и многие другие области. Можно сказать, что вся предыдущая истории человечества — это движение к информационному обществу, в котором роль информации очень высока. Информация – это сведения, являющиеся объектом хранения, передачи и преобразования. Следовательно, важнейшим вопросом теории информации является установление меры и качества информации для оценки потерь при ее хранении и передаче, определение достоверности информации.

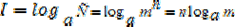

Роберт Хартли американский инженер и математик, работавший в области кибернетики, предложил метод свой метод измерения информации. Пусть дискретное сообщение, передаваемое по каналу связи состоит из « n» элементов, каждый из элементов может находится в одном из «m» состояний.

Сообщение из n элементов называется словом, элемент сообщения называется символом, все возможные состояния m – алфавитом. Определим количество сообщений, которое можно составить из n элементов, принимающих m состояний. Начнем от простого к сложному. Имеем элемент сообщения,

который может принимать 2 состояния. Число различных состояний, которое обозначим, из двух элементов равно =21. Пусть число элементов будет два, тогда число возможных комбинации состояний двух элементов с двумя состояниями, количество комбинаций состояний двух элементов будет равно

который может принимать 2 состояния. Число различных состояний, которое обозначим, из двух элементов равно =21. Пусть число элементов будет два, тогда число возможных комбинации состояний двух элементов с двумя состояниями, количество комбинаций состояний двух элементов будет равно

= 2 2 = 4. В случае трех элементов с двумя состояниями число комбинаций равно = 2 3 = 8. Таким образом, результаты можно обобщить на случай n элементов с m состояниями каждого элемента =

= 2 2 = 4. В случае трех элементов с двумя состояниями число комбинаций равно = 2 3 = 8. Таким образом, результаты можно обобщить на случай n элементов с m состояниями каждого элемента =  . На первый взгляд кажется, что за количество информации можно принять число состояний системы , но эта величина не обладает свойством аддитивности. В 1927 году Робертом Хартли предложена логарифмическая мера количества информации

. На первый взгляд кажется, что за количество информации можно принять число состояний системы , но эта величина не обладает свойством аддитивности. В 1927 году Робертом Хартли предложена логарифмическая мера количества информации

(1.1)

(1.1)

Такая мера количества информации удовлетворяет требованиям аддитивности. Если принять основание логарифма равным 2, что является наиболее удобным в цифровой технике, поскольку используются технические элементы, имеющие, как правило, два состояния. Таким образом, один элемент передаваемого общения с двумя равновероятными состояниями будет иметь одну единицу информации, равную

(1.2)

(1.2)

Один бит это элементарное количество информации, которое несет один элемент, принимающий два различных состояния.

Роберт Хартли предполагал, что все состояния равновероятны. Клод Шеннон снял это ограничение и ввел вероятность состояния m. Чем меньше вероятность состояния, тем большее количество информации оно несет. Например, сообщение о том, что в Якутии зимой температура меньше нуля градусов несет мало информации. Но если температура больше нуля, то это несет очень большое количество информации. Таким образом, количественной мерой информации служит величина, обратная вероятности передаваемого сообщения.

Пусть некоторая физическая система характеризуется N состояниями  ,

,  ,

,  ,…,

,…,  и распределением вероятностей этих состояний

и распределением вероятностей этих состояний  ,

,  ,

,  ,…,

,…,  , образующих полную группу несовместимых событий т.е.:

, образующих полную группу несовместимых событий т.е.:  .

.

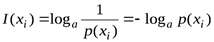

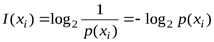

Американский ученый Клод Шеннон в середине 40-х годов прошлого столетия предложил оценивать количество информации в каждом исходе мерой:

.(3.3)

.(3.3)

За количественную меру информации  содержащуюся в некотором сообщении

содержащуюся в некотором сообщении  принимается минус логарифм вероятности этого сообщения

принимается минус логарифм вероятности этого сообщения  .

.

При

, [бит]. (3.4)

, [бит]. (3.4)

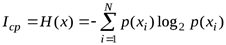

Энтропия сообщения. Среднее количество информации по всем состояниям системы:

(3.5)

(3.5)

где -энтропия системы.

-энтропия системы.

Функция Н была выбрана Шенноном так, чтобы она удовлетворяла следующим требованиям:

1.  должна быть непрерывной относительно

должна быть непрерывной относительно  .

.

2. Если все  равны,

равны,  , тоН должна быть монотонно возрастающей функцией от N. В случае равновероятных событий имеется больше возможностей выбора или неопределенности, чем в случае, когда имеются не равновероятные события.

, тоН должна быть монотонно возрастающей функцией от N. В случае равновероятных событий имеется больше возможностей выбора или неопределенности, чем в случае, когда имеются не равновероятные события.

3. Если бы выбор распадался на два последовательных выбора, то первоначальная  должна была бы быть взвешенной суммой индивидуальных значений

должна была бы быть взвешенной суммой индивидуальных значений  .

.

Шенноном доказано, что существует единственная функция Н, вид которой приведен выше, удовлетворяющая этим трем требованиям. Кроме того, энтропия H характеризуется следующими свойствами:

· энтропия всегда неотрицательна, так как значения вероятностей выражаются дробными величинами, а их логарифмы - отрицательными величинами, т.е. члены  - неотрицательны;

- неотрицательны;

· энтропия равна нулю в том крайнем случае, когда вероятность одного события равна единице, а вероятности всех остальных нулю. Это тот случай, когда об опыте или величине все известно заранее и результат не приносит никакой новой информации;

· энтропия имеет наибольшее значение при условии, когда все вероятности равны между собой  =

=  =

=  =…=

=…=  =

=  . При этом

. При этом  .

.

Таким образом, в случае равновероятности событий статистическое определение количества информации по Шеннону совпадает с определением количества информации по Хартли. Совпадение оценок свидетельствует о полном использовании информационной емкости системы, т.e. формула Хартли соответствует максимальному значению энтропии.

|

|

|

© helpiks.su При использовании или копировании материалов прямая ссылка на сайт обязательна.

|